네이버 부스트캠프 AI Tech/Deep Learning Basics

[부스트캠프 AI Tech] Deep learning basics

중앙백

2022. 1. 22. 17:31

- 신경망(neural network)은 비선형모델이다.

- 신경망을 수식으로 분해하면 다음과 같다

- 각 행벡터o는 데이터x와 가중치 행렬W의 곱으로 표현된다.

- 각 데이터x(행벡터)는 d개의 변수를 갖고 있고 출력에 해당하는 o는 p개의 변수를 갖고 있다. 즉 가중치 벡터 W는

d * p 개의 성분을 갖고 있다. - 출력벡터 o에 softmax 함수를 합성하면 확률벡터로 변한다. 이는 특정 클래스 k에 속할 확률로 해석할 수 있음.

출처 부스트캠프 AI Tech

신경망

- 신경망은 선형모델과 활성함수(activation function)을 합성함 함수이다.

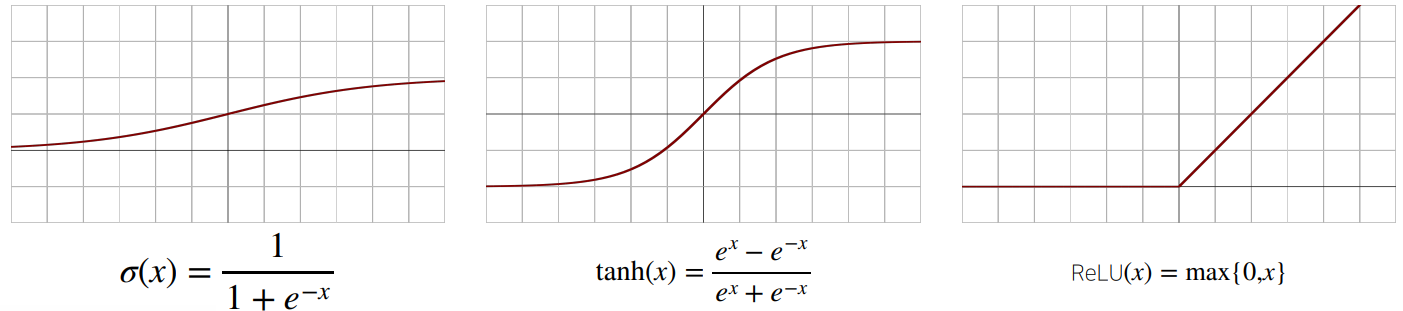

활성함수 시그마로 새로운 잠재벡터 형성 - 활성함수 : R위에 정의된 비선형 함수. 활성함수가 없는 딥러닝은 선형모형과 차이가 없음.

활성함수의 종류 - 신경망을 여러층으로 쌓을 수록 목적함수를 구하는데 필요한 뉴런(노드)의 숫자가 줄어들어 효율적인 학습 가능.

순전파와 역전파

- l = 1, ... , L까지 순차적인 신경망 계산을 순전파(forward propagation)라 부른다.

역전파 - l = L, ..., 1 순서로 연쇄법칙을 통해 그레디언트 벡터를 전달하는 계산을 역전파(backward propagation)이라 한다.